Les déboires imprévus de l’intelligence artificielle : quand la technologie confond gratte-ciel et trombone à coulisse

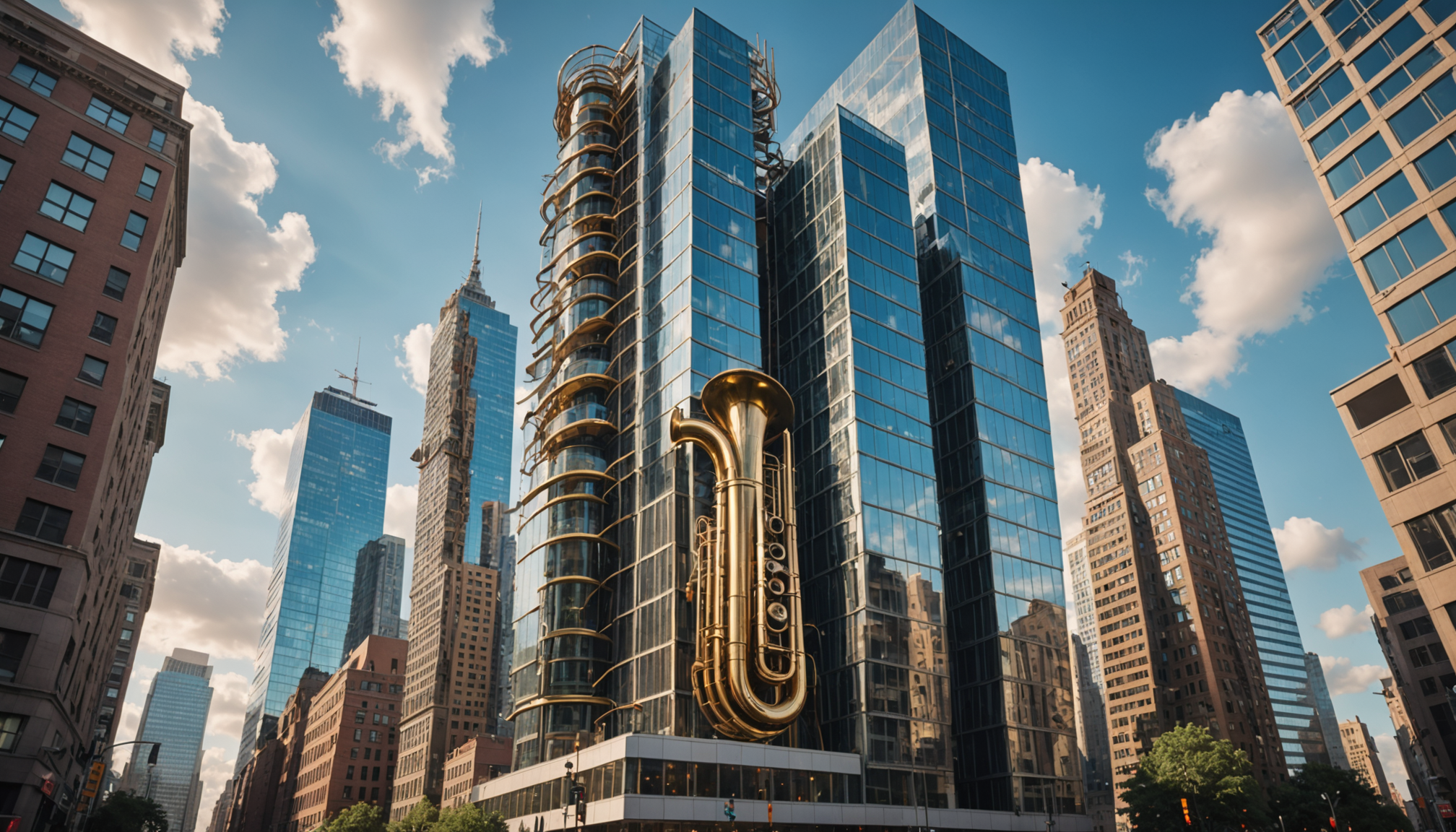

À l’ère des avancées fulgurantes de l’IA, les incidents liés à des erreurs d’interprétation ou d’analyse de données restent fréquents malgré les progrès constants. Un cas particulièrement marquant de déraillement d’intelligence artificielle illustre parfaitement les limites encore présentes lors de la gestion d’objets et concepts très contrastés. Ce scénario étrangement cocasse met en scène un système automatisé chargé d’analyser visuellement un gratte-ciel et un trombone à coulisse, deux objets dont les caractéristiques diffèrent radicalement en taille, forme et fonction. Cette histoire insolite révèle comment une IA, en apparence performante, a réussi à confondre ces deux entités, donnant lieu à des résultats abscons qui interrogent sur la robustesse des technologies employées.

Ce type d’incident met en lumière les complexités auxquelles sont confrontés les développeurs d’algorithmes dans le traitement d’informations multidimensionnelles, particulièrement lorsque les données d’entrée comportent des éléments très hétérogènes. Dans ce cas précis, l’intelligence artificielle a subi un échec flagrant dans la reconnaissance et la différenciation contextualisée d’un élément architectural imposant face à un instrument de musique miniature. Un tel déraillement met aussi en perspective la nécessité d’une supervision attentive et d’une amélioration continue des systèmes d’IA, afin d’éviter ces anomalies qui peuvent parfois paraître triviales mais ont des implications majeures dans des environnements critiques.

| Élément analysé | Caractéristiques | Attendu de l’IA | Résultat obtenu | Conséquences de l’erreur |

|---|---|---|---|---|

| Gratte-ciel | Architecture imposante, grande hauteur | Identification comme construction urbaine majeure | Confusion avec un petit instrument | Perte de contextualisation, données inexploitables |

| Trombone à coulisse | Instrument de musique métallique, petite taille | Reconnaissance comme objet de musique | Assimilé à un élément architectural | Erreurs d’étiquetage, mauvaise classification |

Ce tableau souligne avec précision la nature du décalage entre ce que la technologie d’IA devait réaliser et le résultat finalement produit, soulignant ainsi l’importance d’une approche rigoureuse de la donnée.

Les causes techniques derrière le déraillement de l’IA : compréhension erronée et lacunes algorithmiques

Pour analyser cet incident remarquable, il est primordial d’examiner les mécanismes internes des systèmes d’intelligence artificielle qui ont mené à cette confusion entre deux notions aussi distinctes. Les algorithmes d’apprentissage automatique, en particulier dans le domaine de la reconnaissance visuelle, reposent sur des jeux de données d’entraînement ainsi que sur des réseaux neuronaux profonds qui bâtissent des représentations complexes des objets. Lorsqu’ils reçoivent des images ou des instructions, ils tentent d’identifier des motifs et des caractéristiques pour attribuer une catégorie adaptée.

Cependant, plusieurs facteurs peuvent affecter la précision et la pertinence des résultats. D’une part, un ensemble de données biaisé ou trop limité impacte directement la capacité de l’algorithme à généraliser correctement. Si l’IA a peu d’exemples de trombones à coulisse ou qu’elle a été exposée majoritairement à des images de gratte-ciel dans des contextes similaires, elle peut extrapoler de manière inappropriée. D’autre part, l’absence d’un système de vérification contextuelle robuste peut entraîner des erreurs d’association qui deviennent alors difficilement détectables sans intervention humaine.

Les défis sont encore accentués par la nature intrinsèquement différente des objets à identifier — un gratte-ciel se caractérise avant tout par des traits architecturaux géométriques, la taille, et une présence dans le paysage urbain qui contrastent fortement avec un trombone à coulisse, objet compact avec une forme métallique spécifique. L’IA doit donc non seulement reconnaître des formes abstraites mais aussi connecter cette reconnaissance à une compréhension sémantique, ce qui reste une tâche ardue.

| Facteur | Impact sur l’erreur | Solutions envisagées |

|---|---|---|

| Biais dans le dataset | Surestimation des attributs incorrects | Enrichir et diversifier les données |

| Limitation de la contextualisation | Classification incohérente | Implémenter des règles sémantiques supplémentaires |

| Complexité des formes mixtes | Mauvaise association des objets | Développer des modèles hybrides multi-modaux |

Ce diagnostic insiste sur le fait que la robustesse d’une IA ne réside pas uniquement dans la quantité de données, mais également dans la qualité, la diversité et l’intégration de contextes pertinents dans le pipeline d’analyse.

Conséquences concrètes et éventuelles applications de ce déraillement insolite dans le secteur technologique

Au-delà d’un simple cas d’humour involontaire, cette histoire insolite d’un déraillement algorithmique pose des questions essentielles sur la fiabilité croissante mais aussi les limites réelles des systèmes d’IA actuels dans des environnements de plus en plus complexes. Dans l’univers professionnel, des erreurs similaires peuvent avoir des impacts graves, notamment dans les secteurs de la construction, de la robotique ou encore de la gestion automatisée des infrastructures.

Par exemple, une mauvaise identification d’un élément architectural dans le cadre d’un logiciel dédié à la sécurité ou à la maintenance de bâtiments pourrait entraîner des interventions inadaptées, des surcoûts considérables ou pire, des risques pour la sécurité humaine. Ce type d’incident souligne aussi la nécessité d’un cadre réglementaire adéquat pour encadrer l’utilisation de l’IA, particulièrement quand elle intervient dans des domaines sensibles liés aux infrastructures physiques.

Paradoxalement, des événements de déraillement peuvent aussi stimuler l’innovation. En mettant en évidence les failles des systèmes, ils sont souvent le point de départ pour le développement de méthodes nouvelles, telles que les algorithmes d’apprentissage renforcé avec supervision humaine ou les architectures combinant intelligence artificielle et systèmes experts. Cette innovation continue est essentielle pour que la technologie puisse évoluer en garantissant performances et sécurité.

| Secteur | Impact du déraillement | Mesures correctives | Innovations induites |

|---|---|---|---|

| Construction | Erreurs de reconnaissance structurelle | Systèmes de validation croisée | IA hybride mélangeant vision et données de capteurs |

| Robotique | Mauvaise manipulation d’objets | Apprentissage supervisé renforcé | Robotique adaptative intelligente |

| Sécurité | Faux positifs en détection d’anomalies | Surveillance humaine associée | IA augmentée validée |

Ces évolutions techniques participent à une meilleure intégration de l’intelligence artificielle dans notre quotidien, transformant progressivement les problématiques inattendues en opportunités d’amélioration. Parfois même, apprendre des erreurs permet d’enrichir significativement la technicité de ces systèmes, faisant ainsi reculer les limites du possible.

Réflexion sur les implications éthiques et sociétales des dérives inattendues de l’intelligence artificielle

Au-delà des aspects purement techniques, les incidents comme cette mésaventure entre gratte-ciel et trombone à coulisse posent un certain nombre de questions éthiques liées à la responsabilité, la transparence et le contrôle des technologies d’intelligence artificielle. Ces glitches, bien que parfois amusants, deviennent des signaux d’alarme sur la confiance aveugle que l’on peut accorder à ces systèmes.

Il est essentiel que les entreprises et les institutions investissent dans des mécanismes de contrôle rigoureux, capables de détecter rapidement ces déraillements et d’exiger des audits réguliers de performance. La question de la responsabilité en cas d’erreur devient également cruciale: qui est responsable des conséquences lorsqu’une IA commet une faute liée à une mauvaise interprétation, que ce soit dans un domaine commercial, médical ou sécuritaire ?

En outre, l’intégration de l’intelligence artificielle dans la société amène à repenser la formation des professionnels en charge de ces outils, avec une attention plus forte portée à une compréhension globale du fonctionnement des algorithmes et à une capacité d’adaptation face aux imprévus. Ces épisodes insolites agissent ainsi comme de véritables cas d’école pour renforcer l’interdisciplinarité entre ingénierie, éthique et gestion des risques.

| Aspect éthique | Enjeu | Actions recommandées |

|---|---|---|

| Responsabilité | Détermination des acteurs en cas d’erreur | Mise en place de cadres juridiques clairs |

| Transparence | Compréhension des décisions prises par l’IA | Avoir des systèmes explicables et audités |

| Formation | Appropriation technologique par les utilisateurs | Développement de programmes de formation ciblés |

Les incidents de ce type sont donc une invitation à dépasser le stade purement fonctionnel des outils numériques pour inclure une véritable responsabilité sociétale et éthique dans l’usage de l’intelligence artificielle, particulièrement lorsque celle-ci devient un acteur incontournable de l’innovation.

L’avenir de l’intelligence artificielle à la lumière des incidents surprenants : enseignements et perspectives

Alors que les défaillances électrisantes de l’IA font régulièrement la une des actualités, comme ce fameux incident du gratte-ciel et du trombone à coulisse, elles contribuent à nourrir un débat constructif sur les voies à suivre pour perfectionner ces technologies. L’innovation passe naturellement par la reconnaissance de ses propres erreurs et par la mise en œuvre rapide de solutions adaptées.

Certaines initiatives actuelles encouragent l’élaboration d’architectures d’IA plus résilientes, basées sur des approches multi-phasiques qui combinent intelligence artificielle et intervention humaine pour prévenir les écarts. Des modèles hybrides sont développés afin d’optimiser l’analyse contextuelle et la précision des résultats, notamment dans des situations où les données sont très disparates ou complexes.

Par ailleurs, la question de la confiance envers les systèmes automatisés demeure un enjeu majeur. Seule une amélioration continue appuyée par des retours terrain rigoureux permettra de faire reculer les risques liés aux déraillements dans des applications pratiques. Ce processus implique aussi une implication active des acteurs de la cybersécurité, domaine qui en 2025 connaît un investissement croissant pour sécuriser les systèmes intelligents contre les erreurs mais aussi les attaques malveillantes.

| Aspect | Enjeux futurs | Stratégies adoptées |

|---|---|---|

| Résilience des systèmes | Réduction des erreurs imprévues | Combiner IA et supervision humaine |

| Qualité des données | Amélioration de la précision | Enrichissement continu et audits |

| Sécurité et confiance | Protection contre les cybermenaces | Investissements croissants en cybersécurité notamment |

Il apparaît clairement que malgré les déraillements surprenants et parfois comiques, la trajectoire de l’intelligence artificielle vise à devenir un levier fondamental de l’innovation dans une multitude de domaines, en s’appuyant sur une gestion intelligente des erreurs et une éthique renforcée. Pour en savoir plus sur les défis auxquels fait face l’IA et son impact économique majeur, il est instructif de consulter cette analyse dédiée à la révolution verte induite par l’intelligence artificielle.

Pourquoi une IA confond-elle parfois des objets aussi différents que le gratte-ciel et le trombone à coulisse ?

Les IA sont dépendantes des jeux de données sur lesquels elles sont entraînées. Si ces données sont biaisées ou limitées, ou si le système manque de capacités contextuelles, il risque de confondre des objets aux caractéristiques très diverses.

Quelles sont les implications d’un déraillement d’IA dans les secteurs critiques ?

Un déraillement peut provoquer des erreurs de classification entraînant des risques pour la sécurité, des pertes financières ou des interventions inappropriées, particulièrement dans des domaines comme la construction ou la sécurité.

Comment les entreprises peuvent-elles prévenir ces erreurs ?

En mettant en place des systèmes hybrides combinant intelligence artificielle et supervision humaine, en diversifiant les données d’entraînement, et en réalisant des audits réguliers pour assurer transparence et performance.

Quels rôles jouent la cybersécurité dans la prévention des déraillements d’IA ?

La cybersécurité protège les systèmes d’IA contre les attaques malveillantes qui pourraient provoquer des erreurs ou intoxiquer les données, renforçant ainsi la fiabilité globale des technologies.

L’intelligence artificielle remplacera-t-elle totalement l’humain malgré ces incidents ?

L’IA est conçue pour assister et compléter les capacités humaines. Les déraillements rappellent la nécessité d’une collaboration étroite avec les humains pour garantir sécurité et pertinence des décisions.